Incluso Jeff Bezos ha compartido en su cuenta de Twitter la nueva actualización que consigue resultados más precisos que nunca.

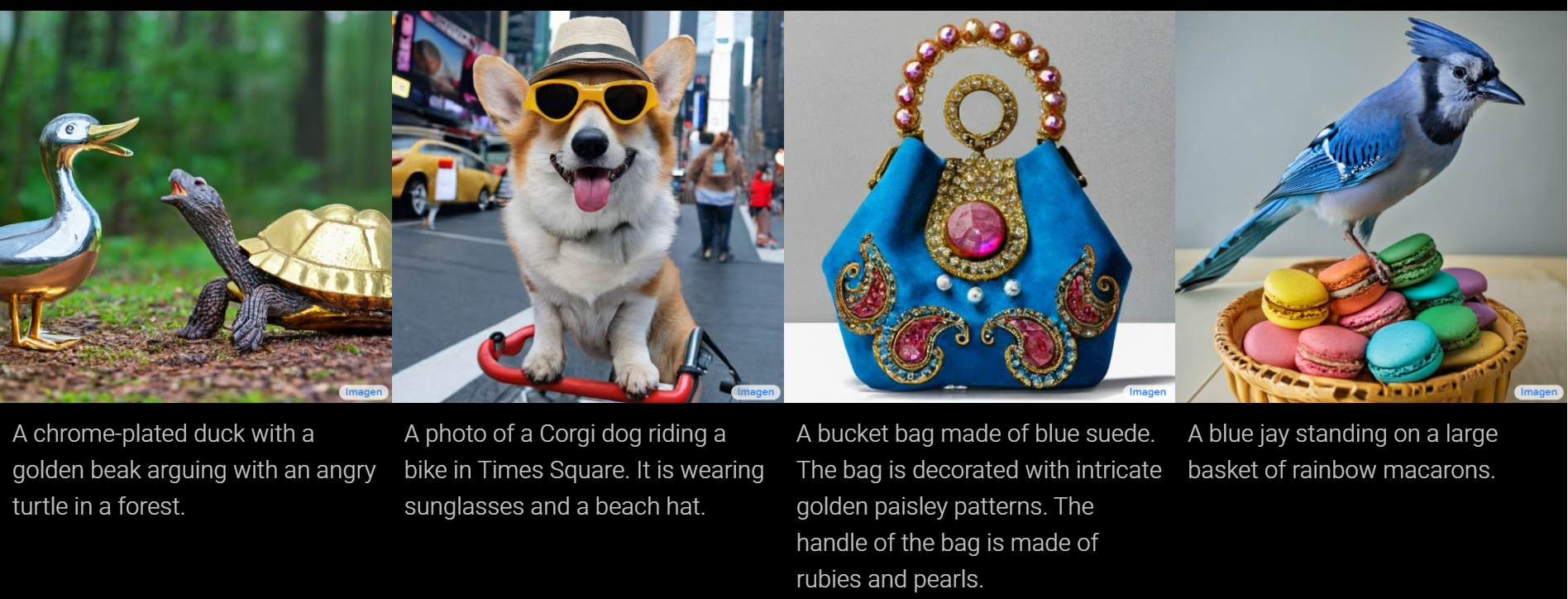

La inteligencia artificial se ha enfrentado con frecuencia a los humanos en combates creativos. Es capaz de vencer a los grandes maestros del ajedrez, crear sinfonías, escribir poemas conmovedores y, ahora, crear arte detallado a partir de una breve indicación. El equipo de OpenAI ha creado recientemente un potente software al que han bautizado como Imagen superando a su predecesor Dall-E con el objetivo de revolucionar la forma en que utilizamos la IA con las imágenes.

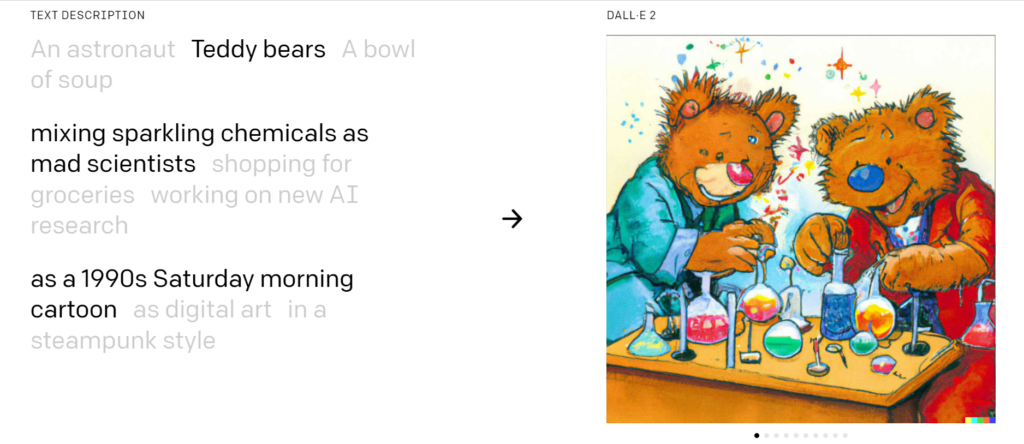

Allá por 2021, la empresa de desarrollo de investigación de IA OpenAI, creó un programa conocido como ‘Dall-E’ -una mezcla de los nombres de Salvador Dalí y Wall-E. El Dall-E 2 es capaz de tomar una palabra y crear una imagen completamente única generada por la IA. Este software no se limita a crear una imagen en un solo estilo, sino que puede añadir diferentes técnicas artísticas a su solicitud, introduciendo estilos de dibujo, pintura al óleo, al estilo de Monet, un modelo de plastilina, tejido de lana, dibujado en la pared de una cueva o incluso como un cartel de cine de los años 60. Este es uno de los ejemplos que muestran en la página oficial del Dall-E 2.

Pero el grande de los buscadores no se iba a conformar y ha ido introduciendo grandes mejoras en el software, creando Imagen, una nueva y potente iteración que rinde a un nivel muy superior. Junto con algunas otras novedades, la diferencia clave de este segundo modelo es una enorme mejora en la resolución de la imagen, una disminución en el tiempo que tarda la imagen en crearse y un algoritmo más inteligente para crear las imágenes.

Tal y como explicó el responsable de IA de la compañía, los sistemas que se nutren de este tipo de IA pueden desentrañar un nuevo mundo de creatividad digital a partir de los ordenadores y la intervención humana. E Imagen de Google consigue hacerlo sin problemas.

Del mismo modo, Jeff Dean mencionó cómo el proyecto es exactamente lo que Google imaginó que sería y todo es gracias a la división de Investigación de la compañía que, después de muchas pruebas y errores, dio con el avance de difundir el texto con imágenes para añadir un nuevo tipo de realismo. Para comprender mejor lo que pueden esperar los usuarios, la empresa mencionó cómo Imagen extrae su brillo gracias al poder de los dispositivos de lenguaje transformador a escala gigante que entienden el texto y lo fusionan con la producción de imágenes.

El principal descubrimiento al final de todo está relacionado con lo increíblemente que el modelo puede codificar el texto y producir imágenes relativas en consecuencia. Y al aumentar el tamaño del modelo de lenguaje de Imagen, se consigue una mejor alineación imagen-texto en comparación con el simple hecho de hacer más grande el modelo de difusión de imágenes.

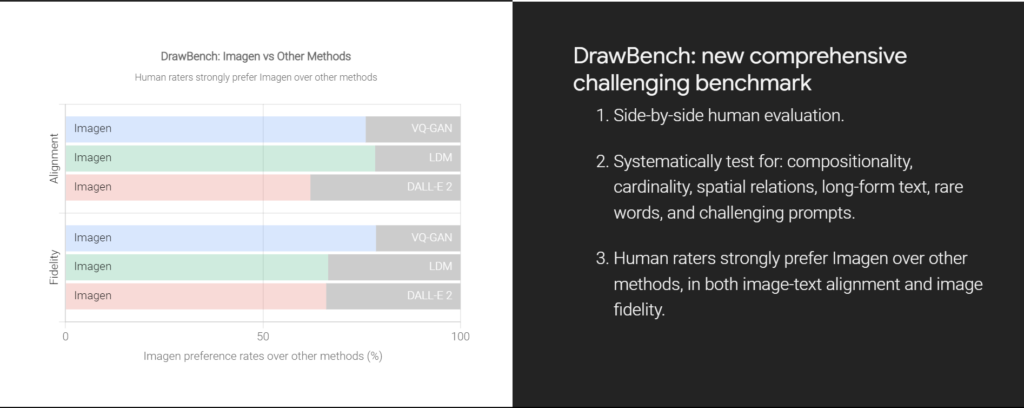

Pero, como dice el refrán, ver es creer, y para comprender mejor cómo funciona todo, la empresa elaboró recientemente su DrawBench, que es el nombre reservado a un benchmark que podría evaluar mejor los modelos de texto-imagen. A través de este método, Google esperaba demostrar al mundo de qué era capaz su nuevo avance.

Y fue entonces cuando la compañía reveló cómo los diseñadores humanos se convirtieron en grandes fans de Imagen, prefiriéndola sobre otros modelos de diseño similares al hacer comparaciones simultáneas. En ellas se tuvo en cuenta tanto la alineación de la imagen y el texto como la calidad de la muestra que se utilizó. Y entre los modelos comunes utilizados para la evaluación se encontraban también DALL-E 2, VQ-GAN y Latent Diffusion.

Del mismo modo, Google habló de cómo las métricas también estaban haciendo un gran trabajo para demostrar las grandes capacidades de Imagen y el buen trabajo que hace a la hora de comprender la solicitud de un usuario. Esto incluye la comprensión de términos poco utilizados, texto en formato largo e incluso relaciones espaciales únicas.

Mientras tanto, otro de los grandes avances de los que habla la compañía está relacionado con el frente arquitectónico U-net, que es más eficiente en términos de detalles de computación al tiempo que cuenta con una mayor capacidad de memoria, por no hablar de una mayor velocidad de convergencia.

Por el momento, Google no ha liberado ningún código específico ni ha hecho una demostración pública de su Imagen, ya que tiene previsto hacerlo pronto, cuando llegue el momento. Sin embargo, Jeff Bezos sí ha compartido unos cuantos ejemplos en su propia cuenta de Twitter con la intención de poner los dientes largos a todos sus seguidores.

Hay que tener en cuenta que, sin contar con las salvaguardias adecuadas, existen grandes posibilidades de que se produzca un mal uso, por lo que la empresa está haciendo todo lo posible para evitarlo. No obstante, los interesados pueden seguir encontrando demostraciones interactivas en su sitio web, junto con un completo documento de investigación que describe nuevos avances sobre las ventajas de estos diversos generadores de imágenes.